## Google DeepMind zrewolucjonizuje świat gier? Genie 3 budzi niepokój rynków i otwiera nowe, militarne perspektywy **29 stycznia 2026 roku zapisał się złotymi zgłoskami w historii rozwoju sztucznej inteligencji, wywołując jednocześnie spore poruszenie na światowych rynkach finansowych.** To właśnie tego dnia Google DeepMind oficjalnie zaprezentował swój Project Genie. Innowacja ta błyskawicznie wpłynęła na notowania giełdowe gigantów branży gier, takich jak Roblox czy Unity Software. Choć wielu dostrzega w tym narzędziu potencjał do rewolucji w tworzeniu gier, ja widzę coś znacznie szerszego – w tym również znaczące możliwości zastosowań militarnych.

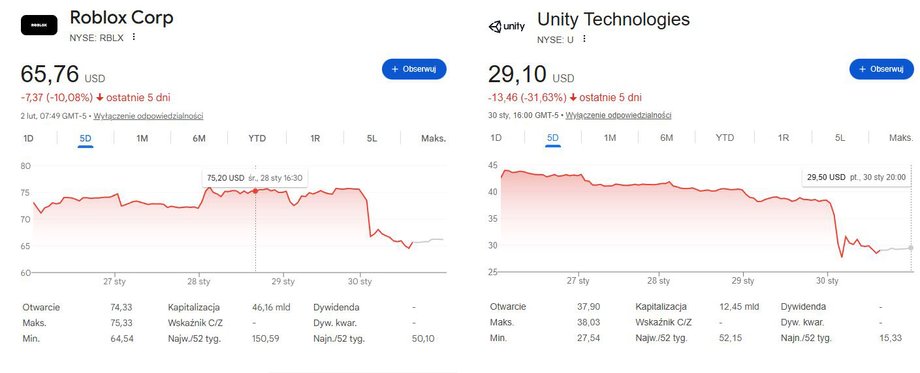

### Kluczowe punkty: * **Uruchomienie Project Genie przez Google DeepMind 29 stycznia 2026 r. wywołało znaczącą reakcję na rynku technologicznym i finansowym.** * **Technologia Genie 3 umożliwia generowanie dynamicznego świata 3D w czasie rzeczywistym na podstawie opisów tekstowych i obrazów.** * **Reakcje giełdowe odzwierciedlały obawy przed zagrażaniem tradycyjnym metodom tworzenia gier wideo i ogólną zmiennością na rynku AI.** * **Główne możliwości Genie 3 obejmują symulowanie podstawowych praw fizyki, przewidywanie interakcji między obiektami oraz tworzenie spójnych środowisk wirtualnych.** * **Project Genie posiada również znaczący potencjał militarny – w perspektywie kilku lat może być wykorzystywany do szkolenia autonomicznych systemów w szerokiej gamie symulowanych warunków.** > „Byłbym zaskoczony, gdyby do 2030 r. to się nie wydarzyło”. Sam Altman o sztucznej inteligencji ### Gwałtowna reakcja rynków Reakcja rynków była natychmiastowa i intensywna. W ciągu zaledwie 48 godzin od oficjalnej zapowiedzi, giełda zareagowała znaczną niepewnością, co doprowadziło do masowej wyprzedaży akcji spółek związanych z branżą gier wideo. Kapitalizacja rynkowa tych firm spadła o miliardy dolarów, odzwierciedlając obawy inwestorów przed potencjalnym przełomem, który może zagrozić dotychczasowym modelom tworzenia gier. Przykładowo, **Unity Software**, twórcy popularnego silnika do produkcji gier, stracili ponad 30% swojej wyceny, co przełożyło się na stratę rzędu około 7 miliardów dolarów (ok. 28 miliardów zł). **Roblox**, platforma umożliwiająca użytkownikom tworzenie własnych produkcji, odnotował spadek o 10%, tracąc ponad 7 miliardów dolarów (ok. 28 miliardów zł).

Również **Take-Two Interactive**, właściciel studia Rockstar Games odpowiedzialnego za serię Grand Theft Auto, zanotował spadek wartości o blisko 10%. Nawet giganci jak Nintendo, a także polski **CD Projekt RED**, nie uniknęli strat, które w sumie opiewają na kolejne miliardy dolarów. * Czytaj także: Doświadczony inwestor twierdzi, że AI to „oczywista bańka”. Jedna spółka ma pociągnąć za sobą resztę Ta sytuacja rodzi kluczowe pytanie: czy Project Genie i model Genie 3 faktycznie zwiastują koniec ery tradycyjnego rozwoju gier, gdzie zespoły programistów, projektantów i artystów spędzają lata na dopracowywaniu tytułów? A może to po prostu kolejna nadmierna reakcja rynku na szum wokół sztucznej inteligencji, podobna do tej, którą obserwowaliśmy po premierach narzędzi takich jak Sora do generowania wideo czy Midjourney do tworzenia obrazów? ### Co to jest Genie 3 i Project Genie? Model Genie 3, zaprezentowany po raz pierwszy przez Google DeepMind w sierpniu 2025 roku, stanowi znaczący krok naprzód w dziedzinie tzw. modeli świata (world models). W uproszczeniu jest to zaawansowany system sztucznej inteligencji, który nie ogranicza się do tworzenia statycznych obrazów czy krótkich filmów, lecz buduje całe dynamiczne, interaktywne środowiska wirtualne. W przeciwieństwie do tradycyjnych generatorów wideo, które tworzą sekwencję obrazów odtwarzaną pasywnie, Genie 3 przewiduje i renderuje kolejne fragmenty świata na bieżąco – w miarę jak użytkownik porusza się po nim za pomocą kontrolera. Proces ten odbywa się z prędkością około 20–24 klatek na sekundę w rozdzielczości 720p, co tworzy iluzję płynnej, choć wciąż dość prostej, interakcji. Model symuluje podstawowe elementy fizyki, oświetlenia, zachowanie wody czy reakcje na ruch. Dodatkowo, stara się utrzymać spójność wizualną i logiczną przez kilkadziesiąt sekund, a maksymalnie kilka minut ciągłej sesji. Aby zrozumieć skalę tej obietnicy, należy odróżnić ją od znanych nam koncepcji, takich jak proceduralne generowanie świata, które widzieliśmy w grach pokroju „No Man’s Sky” czy „Minecraft”. W tych produkcjach algorytm wykorzystuje predefiniowane, stworzone przez ludzi „klocki” – modele 3D, tekstury, zasady kompozycji – do tworzenia pozornie nieskończonych układów. Mamy tu do czynienia z wirtualnym zestawem klocków LEGO; mimo skończonego zbioru elementów, ich kombinacje wydają się nie mieć końca. * Czytaj także: AI wymyka się spod kontroli. „Nie mogą o tym mówić”. To zmieni cały świat Kluczową cechą Genie 3 jest interaktywność w czasie rzeczywistym. Sztuczna inteligencja „przewiduje”, co powinno znajdować się za rogiem, jak obiekty powinny zareagować na działania gracza i jak otoczenie ma ewoluować. To właśnie odróżnia Genie 3 od wcześniejszych generacji modeli DeepMind (jak Genie 1 i Genie 2) oraz od konkurencyjnych rozwiązań do generowania wideo. Google podkreśla, że technologia ta stanowi ważny krok w kierunku stworzenia sztucznej inteligencji ogólnej (AGI), ponieważ pozwala na trenowanie autonomicznych agentów AI w nieskończenie zróżnicowanych, symulowanych środowiskach, ucząc ich nawigacji, podejmowania decyzji i rozumienia fizyki świata bez konieczności wykorzystania danych z rzeczywistego świata. ### Dlaczego to rodzi problemy? Gdy emocje po prezentacji opadną, inżynierowie i twórcy gier będą musieli zmierzyć się z szeregiem wyzwań o skali porównywalnej do przedsięwzięć kosmicznych. Kluczową kwestią jest problem pamięci i spójności. Wyobraźmy sobie, że gracz wchodzi do sklepu. AI generuje całe jego wnętrze: ladę, półki z towarami, lodówki, kasę i sprzedawcę. Gracz następnie wychodzi, wyrusza na długą misję, by po jakimś czasie postanowić wrócić do tego samego sklepu. Co zastaje? W idealnym scenariuszu – tę samą ladę, te same towary i lodówki. Ale jak to osiągnąć? Sztuczna inteligencja nie „renderuje” przecież gotowego pliku, który można zapisać. Musiałaby gdzieś przechowywać semantyczny opis tego pomieszczenia – rodzaj „kodu DNA”, który pozwoliłby na odtworzenie identycznego (lub przynajmniej percepcyjnie identycznego) stanu.

To generuje ogromne obciążenie dla pamięci. Każdy opuszczony pokój, każdy wyrzucony przez gracza przedmiot, każda dziura po kuli w ścianie musiałaby zostać zapisana w gigantycznej, dynamicznej bazie danych świata. Im większy i bardziej interaktywny świat, tym większa ta baza, a jej odczytywanie i przetwarzanie w czasie rzeczywistym staje się koszmarem architektonicznym. To prowadzi do nieuniknionej konkluzji, która mocno ostudza entuzjazm: pierwsze, jakiekolwiek grywalne implementacje tej technologii, będą z konieczności prymitywne i ograniczone gatunkowo. Aby uniknąć problemu pamięci, po prostu… nie pozwolą graczowi wracać do wcześniej odwiedzonych miejsc. Naturalnym gatunkiem dla prototypu takiej gry byłby zatem endless shooter lub runner, gdzie gracz nieustannie pędzi do przodu, a świat generuje się przed nim, by natychmiast zniknąć z pamięci za jego plecami. * Czytaj także: Vibe coding i vibe apokalipsy. Wisi nad nami katastrofa na skalę Czarnobyla Rozwiązanie tego dylematu może również wymagać tak skomplikowanej i zasobożernej infrastruktury, że okaże się komercyjnie nieopłacalne. Można sobie wyobrazić model, który dla każdego pomieszczenia przechowuje „semantyczny seed” – skompresowany opis jego zawartości. Lecz co się stanie, gdy gracz przesunie jeden z tysięcy generowanych przedmiotów? Czy zapisana zostanie nowa pozycja każdego z nich? To rodzi widmo bazy danych tak ogromnej i dynamicznej, że jej utrzymanie i przetwarzanie w czasie rzeczywistym uczyniłoby grę nieopłacalną dla producenta i niedostępną cenowo dla gracza. Szczególnie, że już samo generowanie 30 obrazów na sekundę zużywa ogromne zasoby. Kilka minut takiej rozgrywki mogłoby kosztować więcej niż zakup współczesnej gry. W grę wchodzi tu model streamingu – gra działałaby na potężnych serwerach, a gracz jedynie odbierałby strumień wideo, podobnie jak w usługach typu GeForce NOW. To jednak rodzi kolejne problemy z opóźnieniami, dostępnością i ceną abonamentu, który musiałby pokryć niebotyczne rachunki za prąd. Szacuje się, że jedna 60-sekundowa sesja pochłania zasoby porównywalne z trenowaniem małego modelu przez kilka godzin na klastrze setek GPU. Wreszcie, pojawia się problem kontroli jakości i spójności artystycznej. Gdy twórcy ręcznie projektują grę, każdy element ma swoje miejsce i znaczenie. Świat jest wtedy celowo zaprojektowany. Tymczasem świat generowany przez AI to seria statystycznych prawdopodobieństw. Jak zagwarantować, że styl architektoniczny generowanego miasta będzie spójny? Jak zapobiec sytuacji, w której AI, kierując się czystą logiką, wygeneruje drzwi prowadzące wprost w przepaść? Bez niezwykle precyzyjnych i restrykcyjnych „promptów” sterujących, które same w sobie stanowiłyby formę projektowania, grozi nam powstanie świata, który jest jedynie powierzchowną, surrealistyczną papką, pozbawioną głębi i artystycznej wizji. ### Opinie ekspertów i branży Reakcja społeczności deweloperskiej na Project Genie była znacznie bardziej wyważona niż panika na giełdzie. Większość osób bezpośrednio zaangażowanych w tworzenie gier – zarówno niezależnych, jak i tych z segmentu AAA – uznała technologię za imponującą, ale daleką od bycia „zabójcą branży”. Na platformie X oraz w zamkniętych grupach Discord i na forach branżowych dominują komentarze w stylu: „To niesamowity krok naprzód w symulacji świata, ale wciąż nie jest to gra”, „rynek jest przewrażliwiony – kupujcie na spadkach” czy „Genie 3 to narzędzie, a nie produkt końcowy”. Tim Sweeney, CEO Epic Games, twórca silnika Unreal Engine, jest technologią zachwycony, ale nie postrzega jej jako bezpośredniego zagrożenia dla własnego biznesu. Nie będzie wielką tajemnicą, że zarówno twórcy Unreal Engine, jak i Unity, pracują nad różnymi implementacjami AI, i dla nich takie rozwiązanie to nie tyle konkurencja, co jedno z przyszłych narzędzi, z których sami będą korzystać. Na chwilę obecną można śmiało stwierdzić, że Genie 3 zabija gry w takim samym stopniu, jak Sora zabija Hollywood – czyli wcale. Po premierze Sory w 2024 roku akcje studiów filmowych rzeczywiście spadły, ale dwa lata później produkcje nadal powstają w tradycyjny sposób, a Sora służy głównie jako narzędzie koncepcyjne i wspomagające tworzenie efektów specjalnych. Jednakże, w dłuższej perspektywie (czyli po 2030 roku), modele świata staną się najprawdopodobniej fundamentem dla prawdziwych, uniwersalnych symulatorów rzeczywistości. To właśnie w takich środowiskach będą trenowane zaawansowane agenty AI – od autonomicznych robotów i samochodów samojezdnych, po wirtualnych asystentów i systemy podejmujące decyzje w warunkach niepewności. ### Patrzymy w złą stronę Przedstawiciele DeepMind sami podkreślali w oficjalnych komunikatach, że celem Genie 3 nie jest zastąpienie deweloperów gier, lecz stworzenie uniwersalnego środowiska do trenowania agentów AI – zarówno do zastosowań gamingowych, jak i w robotyce, pojazdach autonomicznych czy symulacjach naukowych. I tu dopatrywałbym się prawdziwej przełomowości tego rozwiązania. Project Genie to narzędzie do tworzenia interaktywnych światów, w których agenci sztucznej inteligencji będą mogli bez przeszkód generować różnorodne warunki, w których będą się doskonalić. * Czytaj także: Eksperci ostrzegają przed „rojami AI”. „System wykorzystuje ludzkie słabości” Nie trzeba mieć niezwykłej wyobraźni, by znaleźć mnóstwo scenariuszy, w których taka technologia może zostać wykorzystana chociażby… militarnie. Szkolenie autonomicznych maszyn bojowych w różnych warunkach pola walki, generowanych automatycznie przez same te maszyny? Brzmi jak sposób na wyszkolenie systemów w każdych możliwych warunkach, bez konieczności opuszczania granicy oprogramowania i sprzętu. Jednym z kluczowych potencjałów jest trening autonomicznych maszyn bojowych, takich jak drony, roboty lądowe czy pojazdy bezzałogowe. Tradycyjne metody szkolenia AI wymagają drogich, czasochłonnych testów w realnym świecie, co niesie ryzyko uszkodzeń sprzętu, strat ludzkich czy ograniczenia dostępnych danych treningowych. Genie 3 rozwiązuje ten problem, generując wirtualne środowiska, w których agenci AI mogą ćwiczyć w nieskończonej liczbie wariantów – od walk ulicznych w mieście, przez operacje na pustyni, po symulacje katastrof naturalnych czy cyberataków. Genie 3 może symulować całe teatry operacji wojskowych, analizując kursy akcji, optymalizując logistykę czy przewidując skutki ataków. Na przykład, armia mogłaby generować scenariusze ataków dronowych na cele wroga, testując tysiące wariantów w czasie rzeczywistym. W kontekście rywalizacji mocarstw, jak USA-Chiny, modele świata takie jak Genie mogą stać się kluczowe w symulowaniu nie tylko bitew, ale również symulatorów przeciwnika – prowadząc do abstrakcyjnej wojny, gdzie wygrywa ten, kto lepiej modeluje rzeczywistość.

Źródło wiadomości : businessinsider.com.pl