Darmowy asystent AI, który w zaledwie kilka tygodni stał się najszybciej zyskującym na popularności oprogramowaniem open-source w historii. Szał na punkcie OpenClaw nie słabnie, jednak im więcej użytkowników go pobiera i instaluje, tym więcej ekspertów od cyberbezpieczeństwa łapie się za głowę i bije na alarm.

Dalsza część tekstu znajduje się pod materiałem wideo:

Dalszy ciąg artykułu pod materiałem wideo Prompt injection – jak działa i dlaczego twórcy AI tak bardzo się go boją. KŚ wyjaśnia

Gorączka na punkcie agentów AI i skąd wziął się OpenClaw?

Zgodnie z przewidywaniami, po czatbotach, wykorzystanie agentów AI w branży technologicznej skupionej na sztucznej inteligencji jest obecnie najgorętszym tematem. AI już pomaga zarządzać największymi korporacjami, a niektóre z nich zatrudniają więcej botów niż ludzi. Choć jest to technologia wciąż nowa, entuzjazm wynikający z wizji wyraźnie wyższej wydajności przysłania wielu decydentom nieco szerszą perspektywę.

To, co jednak wydawało się początkowo jedynie domeną osób najściślej związanych z nowymi technologiami, czyli zajmujących się kodowaniem, szybko zaczęło przenikać także do innych obszarów. W dużej mierze odpowiedzialny jest za to projekt znany obecnie jako OpenClaw. Stworzony zgodnie z ideą „vibe coding” przez Petera Steinbergera, początkowo jako ClawdBot pod koniec 2025 r. Na początku stycznia przeszedł gruntowną przebudowę i to od tego momentu narzędzie, nazywane także Moltbotem, zaczęło robić prawdziwą furorę.

Na GitHubie projekt pobierało coraz więcej osób, ale prawdziwe szaleństwo rozpoczęło się w połowie lutego, kiedy to pojawiła się wersja 2.0, a nazwę ponownie zmieniono – tym razem już na OpenClaw. Skalę tego zjawiska najlepiej ilustruje tzw. system gwiazdek przyznawanych przez użytkowników, którzy polecają dane rozwiązanie i uważają je za przydatne.

OpenClaw w zaledwie trzy miesiące od premiery zdobył ponad 330 tysięcy gwiazdek, stając się 9. najlepiej ocenianym projektem na tej platformie. To zdecydowanie najwyższa dynamika w historii GitHuba. Warto wspomnieć, że Linux, najpopularniejszy darmowy system operacyjny, potrzebował 14 lat, aby przekroczyć poziom 200 tysięcy gwiazdek. OpenClaw przebił ten pułap w zaledwie kilka tygodni.

Wraz z obsługą większej liczby modeli językowych i zdobyciem nowych umiejętności, możliwości narzędzia w obecnej formie można opisać następująco: po prostej instalacji i konfiguracji OpenClaw otrzymujemy agenta AI, który jest w stanie całkowicie samodzielnie zarządzać naszym urządzeniem – telefonem, tabletem czy komputerem. A robi to dokładnie to, co człowiek, ale bez ludzkiej ingerencji.

Fakt, że polecenia agentom zbudowanym w ramach OpenClaw można wydawać za pomocą zwykłych komunikatorów, prostym językiem, tak jakbyśmy rozmawiali ze znajomym, sprawił, że rozwiązanie w błyskawicznym tempie zainteresowało także osoby, które wcześniej nie miały do czynienia z taką technologią. Jensen Huang w niedawnej rozmowie na temat tego narzędzia z Jimem Cramerem z CNBC przyznał wprost: — To niewątpliwie nowy ChatGPT.

Agent AI może potrafić wszystko

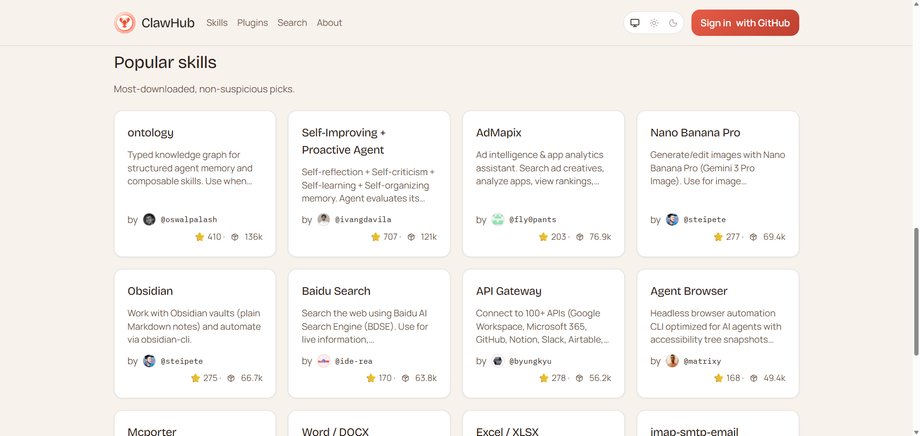

OpenClaw jako taki jest jednak jedynie środowiskiem, a jego prawdziwa moc odblokowuje się, gdy zaczynamy uczyć zbudowanego w nim agenta nowych umiejętności. Jeśli z czymś sobie nie radzi – możemy mu po prostu powiedzieć, aby się tego nauczył i pobrał odpowiednią wtyczkę z bardzo szerokiego katalogu specjalistycznych rozwiązań tworzonych przez użytkowników. Tak zwany ClawHub obejmuje obecnie już kilkadziesiąt tysięcy gotowych instrukcji, które agent w OpenClaw może w krótkim czasie przyswoić. Jeśli potrzebujemy AI do obsługi faktur – z pewnością znajdziemy tam odpowiednią wtyczkę. Potrzebujemy przeprowadzić analizę rynkową, np. wśród dostępnych aplikacji finansowych? Sprawdzić, co oferują, ile zarabiają, ile osób je pobrało? Do tego również istnieje odpowiednia wtyczka, którą można wgrać z ClawHub do naszego agenta. Możliwości są praktycznie nieograniczone.

Brzmi to absolutnie fenomenalnie i nawet wtedy, gdy uwzględnimy koszty operacyjne agenta – możemy bardzo dużo zyskać. O ile nie mamy lokalnego modelu na komputerze, musimy korzystać z klucza API od Google, OpenAI lub dowolnego innego dostawcy modeli AI, co wiąże się z niewielkimi opłatami za każde zapytanie. Wykorzystywane w ten sposób tokeny, czyli jednostki miary danych przetwarzanych przez model, kosztują dziś ułamki groszy, co sprawia, że za wykonanie przez agenta AI konkretnego zlecenia – jak na przykład analiza raportu czy rezerwacja biletów – zapłacimy zazwyczaj od kilku do kilkudziesięciu groszy. To naprawdę niewiele, a uwolniony w ten sposób czas jest w oczywisty sposób znacznie cenniejszy.

Tylko skoro to tak wspaniałe… to oznacza, że gdzieś musi w tym wszystkim kryć się haczyk. I faktycznie się kryje.

Kod czerwony i największy problem OpenClaw

Największą bolączką OpenClaw, jak i wszystkich innych narzędzi związanych z agentami AI, jest mianowicie ich… bezpieczeństwo. Agent AI, aby skutecznie działać, musi otrzymać bardzo szerokie uprawnienia, a instalując OpenClaw, pozwalamy mu na głęboki dostęp do naszego systemu operacyjnego i wszystkich jego zasobów. Choć sztuczna inteligencja potrafi w ten sposób zrobić wiele… równie wiele może zepsuć. Lub wręcz bezpowrotnie usunąć.

Problematyczny jest jednak także fakt, że w ekosystemie ClawHub pojawia się coraz więcej wtyczek zawierających szkodliwy kod. Według raportu Koi Security, na nieco ponad 2800 zbadanych wtyczek, aż 341 zawierało złośliwe oprogramowanie. Z kolei badania przeprowadzone przez Snyk wykazały, że w aż 36% wszystkich wtyczek dla agentów AI można znaleźć luki bezpieczeństwa. Luki, które można wykorzystać na przykład do przejęcia kontroli nad danym systemem.

W rozmowie z Business Insider Polska, Łukasz Nowatkowski, Cybersecurity Advocate w Xopero Software S.A., zwraca uwagę także na jeszcze jedną kwestię: — Największym, przemilczanym zagrożeniem jest to, co nazywamy „halucynacjami operacyjnymi”. (…) Jeśli Agent źle zinterpretuje kontekst i w ramach optymalizacji wykasuje całą bazę klientów zamiast ją zduplikować, mamy do czynienia z katastrofą.

Takie przypadki miały już miejsce, i to także w największych technologicznych firmach świata. Dość powiedzieć, że niedawna awaria Amazon Web Services w prostej mierze wynikała z działań podjętych przez agenta AI, który bez odpowiedniego nadzoru podjął aktywności zaburzające stabilność całego systemu.

Nowatkowski zwraca także uwagę na to, że choć ludzie również popełniają tego typu błędy, z samej swojej natury pole ich działania jest ograniczone. Nieostrożnie wdrażani w organizacji agenci AI nie mają takich ograniczeń: — Dajemy agentom potężne uprawnienia, całkowicie omijając procesy bezpieczeństwa, które stosujemy wobec ludzi. Pracownik ma logowanie dwuskładnikowe i ograniczone godziny pracy. Agent AI często dostaje twardo zaszyte w kodzie hasło i dostęp 24/7. Jeśli zostanie „przejęty” lub zmanipulowany przez złośliwego bota, atakujący przestępca otrzymuje niczym nieograniczony dostęp do wnętrza naszej organizacji.

Eksperci ds. cyberbezpieczeństwa ostrzegają przed OpenClaw

Najbliżej wiąże się to z bardzo niebezpiecznym i obecnie trudnym do zablokowania zjawiskiem wykorzystującym ataki typu „prompt injection”, które w prosty sposób mogą zmuszać zarówno chatboty, jak i agentów AI do wykonywania operacji szkodzących ofierze ataku.

To bardzo duży problem, który w oczach osób rozumiejących działanie tych systemów i poruszających się w tematyce cyberbezpieczeństwa może nie tyle dyskwalifikuje te rozwiązania, co wywołuje poważne obawy. A gdy z nich w jakikolwiek sposób mimo wszystko korzystają, stosują szereg innych zabezpieczeń, ale i one wcale niczego nie gwarantują.

Warto wspomnieć, że zapytana o OpenClaw, wówczas jeszcze pod inną nazwą, szefowa działu bezpieczeństwa w Google, Heather Adkins, powiedziała wprost: — Nie korzystajcie z Clawdbota.

Od tamtego momentu, przez kilka ostatnich tygodni, oczywiście sporo się w tej sprawie zmieniło – OpenClaw w kolejnych wersjach ma nakładane kolejne ograniczenia systemowe, ale… do ideału wciąż bardzo daleko. Pojawiają się też dodatkowe środowiska, niejako „pętające” mu ręce w sytuacji, gdy agent AI miałby zostać wykorzystany do wyrządzenia szkód. Jednym z takich przykładów jest stworzony niedawno przez Nvidię NemoClaw.

Agenci zbudowani w obrębie tego rozwiązania wciąż potrafią realizować większość zleconych im zadań, ale ograniczony dostęp do kluczowych elementów systemu i lepsze zabezpieczenia przed zewnętrzną ingerencją mają sprawić, że całość ma być po prostu bezpieczniejsza w użyciu. Aby wszystko to poprawnie funkcjonowało, potrzebne jest jednak posiadanie układów Nvidii, co samo w sobie dla niektórych podmiotów będzie sporym ograniczeniem. Na tym etapie jest oczywiście za wcześnie, aby ocenić, jak NemoClaw sprawdza się w realnych warunkach i jak bardzo jest „bezpieczny”, ale kierunek rozwoju jest zrozumiały. Agenci tworzeni w obrębie OpenClaw – byli, są i będą niebezpieczni. I dla dalszego rozwoju tej technologii konieczne jest wyraźne poprawienie tego obszaru.

Jak bezpiecznie wdrożyć agenta AI w firmie?

Łukasz Nowatkowski, zapytany o to, czy da się realnie uczynić to rozwiązanie bezpiecznym, wskazał cztery filary, do których każda organizacja powinna dążyć przy włączaniu agentów w strukturę. Są to:

- Dynamiczne zarządzanie sekretami (korzystanie przez agenta wyłącznie z krótkotrwałych uprawnień, które wygasają automatycznie zaraz po wykonaniu konkretnego zadania)

- Behawioralny nadzór w czasie rzeczywistym (stałe analizowanie procesu myślowego agenta i natychmiastowe blokowanie go w przypadku wykrycia anomalii lub prób nieautoryzowanego eksportu danych)

- Fizyczny Kill-Switch (narzędzia administratora do błyskawicznego odcięcia agenta od API bez konieczności przerywania pracy pozostałych systemów firmy)

- Zabezpieczenie protokołu Model Context Protocol (rygorystyczna walidacja komend na styku agenta z narzędziami, aby zapobiec powszechnym w tym protokole atakom typu prompt injection)

Wdrożenia bez uwzględnienia tych zasad to ogromne ryzyko i Nowatkowski przyznaje wprost – to otwieranie drzwi dla cyberprzestępców na oścież.

Stosując się do tych czterech zasad, firma znacząco minimalizuje ryzyko katastrofy związanej z nieprawidłowym działaniem agenta. Jednak z racji tego, że w przypadku oddania kompetencji w ręce AI, na tym etapie rozwoju technologii, nie da się tego ryzyka całkowicie wyeliminować, wiele podmiotów – zwłaszcza tych związanych z administracją państwową, operujących na bardzo wrażliwych danych – całkowicie zakazuje używania narzędzi tego typu. To nie przypadek, a raczej przejaw odpowiedzialności, której wiele biznesów obecnie się nie wykazuje… z bardzo prostej przyczyny – potencjalne zyski przysłaniają ryzyka. Korzyści produktywności są zbyt duże, by biznes z nich zrezygnował – przyznał w rozmowie z Business Insider Polska Nowatkowski. Zapytany o to, co radziłby przedsiębiorstwom, które już teraz popadły w agentowe szaleństwo i wpuszczają AI w swoje struktury, powiedział wprost: — Róbcie to dalej, ale zapnijcie pasy, przygotujcie prawników, bo stąpacie po cienkim lodzie.

Przewiduje także, że obecnie trwające zjawisko zachłyśnięcia się agentami AI przez wiele firm może niebawem przynieść mało przyjemne skutki: — Biznes zrozumie wkrótce, że koszt przestoju spowodowanego przez „zbuntowanego” lub zhakowanego Agenta, połączony z karami z tytułu NIS2/RODO, drastycznie przewyższa zyski z tej pochopnej automatyzacji.

Kto odpowiada za błędy popełnione przez agentów AI?

Temat związany z odpowiedzialnością za błędy, które prędzej czy później zaczną pojawiać się w firmach, które już teraz wdrażają agentów AI, to zresztą kwestia bardzo złożona… choć uregulowana już częściowo prawnie. Kiedy agent AI się pomyli i wykasuje zasoby należące do firmy albo odda je podczas ataku na zewnątrz, kto jest za to odpowiedzialny? Twórcy kodu? Twórca wtyczki, która nadała mu nowe umiejętności? Osoba wdrażająca agenta do organizacji? Od momentu wdrożenia europejskiej dyrektywy NIS2 w roku 2022 oraz znowelizowania polskiej ustawy o Krajowym Systemie Cyberbezpieczeństwa, prawo jest tu jednoznaczne – odpowiedzialność za incydenty wynikające z działalności agentów AI w ramach struktury firmy, w całości spada na zarząd podmiotu, który danego agenta u siebie wdrożył.

Jeśli wdrażasz OpenClaw do obsługi swoich klientów, to OpenClaw staje się twoim łańcuchem dostaw. Jeżeli agent wywoła wyciek danych, organy nadzorcze uznają to za rażące niedbalstwo ze strony firmy – wyjaśnia Łukasz Nowatkowski.

I wskazuje jednocześnie, że towarzyszy temu odpowiedzialność finansowa: — Kary idą w miliony euro, a w skrajnych przypadkach członkowie zarządu odpowiadają osobistym majątkiem lub otrzymują zakaz pełnienia funkcji kierowniczych. To nie algorytm idzie siedzieć – tylko prezes, który pozwolił na jego wdrożenie bez nadzoru.

Dziękujemy, że przeczytałaś/eś nasz artykuł do końca. Bądź na bieżąco! Obserwuj nas w Google.

Wyniki Biznes Fakty:

- OpenClaw zdobył ponad 330 tysięcy gwiazdek na GitHubie w ciągu trzech miesięcy od premiery, stając się 9. najlepiej ocenianym projektem.

- Koszt operacyjny agenta AI (tokeny API) to zazwyczaj od kilku do kilkudziesięciu groszy za wykonanie zlecenia.

- 36% wtyczek dla agentów AI może zawierać luki bezpieczeństwa.

- Według raportu Koi Security, 341 z 2800 zbadanych wtyczek dla OpenClaw zawierało malware.

- Wdrożenie agentów AI bez odpowiednich zabezpieczeń może skutkować karami finansowymi idącymi w miliony euro oraz osobistą odpowiedzialnością zarządu.

- NIS2 i polska ustawa o Krajowym Systemie Cyberbezpieczeństwa jednoznacznie wskazują zarząd firmy jako odpowiedzialny za incydenty spowodowane przez agentów AI.

Szczegóły można znaleźć na stronie internetowej : businessinsider.com.pl