Oto przetłumaczony i przepisany artykuł, zgodny z podanymi wytycznymi:

„Poddanie się poznawcze” to zjawisko, w którym użytkownicy sztucznej inteligencji (AI) zaczynają polegać na jej zdolnościach do tego stopnia, że porzucają własne logiczne myślenie. Badania eksperymentalne wskazują, że znacząca większość badanych bezkrytycznie akceptuje nawet błędne odpowiedzi generowane przez AI. Co więcej, osoby korzystające z błędnej AI częściej popełniają błędy, ale jednocześnie wykazują wyższy poziom pewności siebie co do swoich odpowiedzi. Co ciekawe, osoby o wyższym ilorazie inteligencji rzadziej sięgają po wsparcie AI, a jeśli już to robią, są bardziej skłonne do odrzucania lub negowania nieprawidłowych sugestii algorytmu.

W kontekście narzędzi opartych na dużych modelach językowych (LLM), obserwujemy podział użytkowników na dwie główne grupy. Pierwsza traktuje AI jako potężne, lecz czasem zawodne narzędzie, wymagające stałego nadzoru i weryfikacji ludzkiej w celu wykrywania potencjalnych błędów logicznych lub merytorycznych. Druga grupa natomiast rutynowo deleguje procesy krytycznego myślenia do postrzeganej jako wszechwiedzącej maszyny.

Analiza eksperymentalna

Najnowsze badania rzucają nowe światło na psychologiczne mechanizmy leżące u podstaw postawy tej drugiej grupy, która ulega „poddaniu poznawczemu” wobec pozornie autorytatywnych odpowiedzi AI. Badania te dostarczają również eksperymentalnej analizy czynników wpływających na decyzje o zlecaniu myślenia sztucznej inteligencji, uwzględniając presję czasu czy zewnętrzne bodźce.

Wystarczy zapytać automatyczną sekretarkę

Naukowcy z Uniwersytetu Pensylwanii, w artykule „Thinking—Fast, Slow, and Artificial: How AI is Reshaping Human Reasoning and the Rise of Cognitive Surrender”, oparli swoje analizy na istniejących modelach podejmowania decyzji:

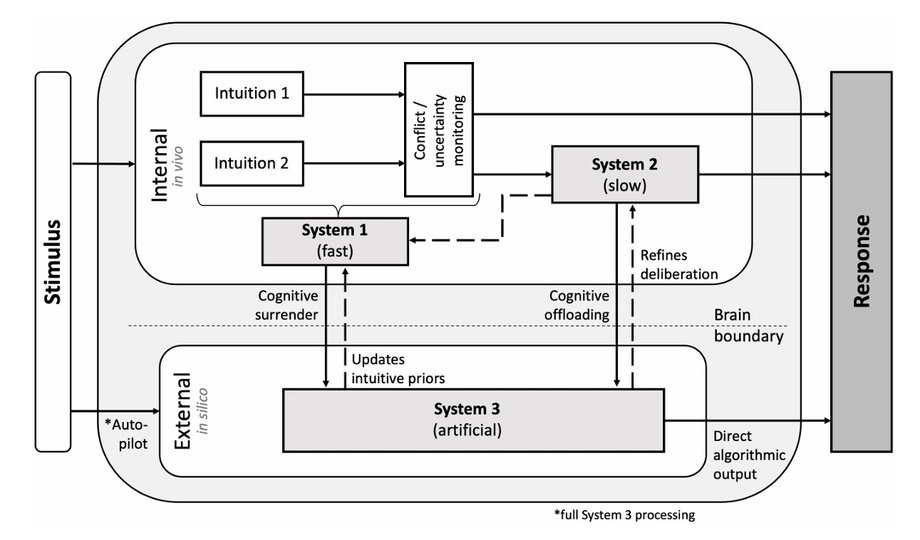

- System 1: charakteryzuje się szybkim, intuicyjnym i emocjonalnym przetwarzaniem informacji.

- System 2: odpowiada za wolne, przemyślane, deliberacyjne i analityczne rozumowanie.

Autorzy pracy sugerują, że pojawienie się systemów AI stworzyło nową, trzecią kategorię podejmowania decyzji (System 3): „sztuczne poznanie”, gdzie decyzje są podejmowane na podstawie zewnętrznego, algorytmicznego rozumowania opartego na analizie danych, a nie na procesach myślowych człowieka.

Odciążenie poznawcze

W przeszłości ludzie często korzystali z narzędzi takich jak kalkulatory czy nawigacje GPS, aby dokonać „odciążenia poznawczego” w konkretnych zadaniach. Strategicznie delegowali pewne obowiązki niezawodnym algorytmom, jednocześnie nadzorując i oceniając wyniki za pomocą własnego, wewnętrznego rozumowania. Naukowcy twierdzą jednak, że systemy AI doprowadziły do powstania fundamentalnie odmiennego zjawiska „poddania się poznawczego”, w którym użytkownicy wykazują „minimalne zaangażowanie wewnętrzne” i bezrefleksyjnie akceptują logikę AI, nawet bez weryfikacji. Jak wskazują autorzy, to „bezkrytyczne zrzeczenie się procesu rozumowania” jest szczególnie powszechne, gdy wyniki generowane przez LLM są prezentowane „płynnie, pewnie lub z minimalnym oporem”.

Metodologia badań i skala zjawiska

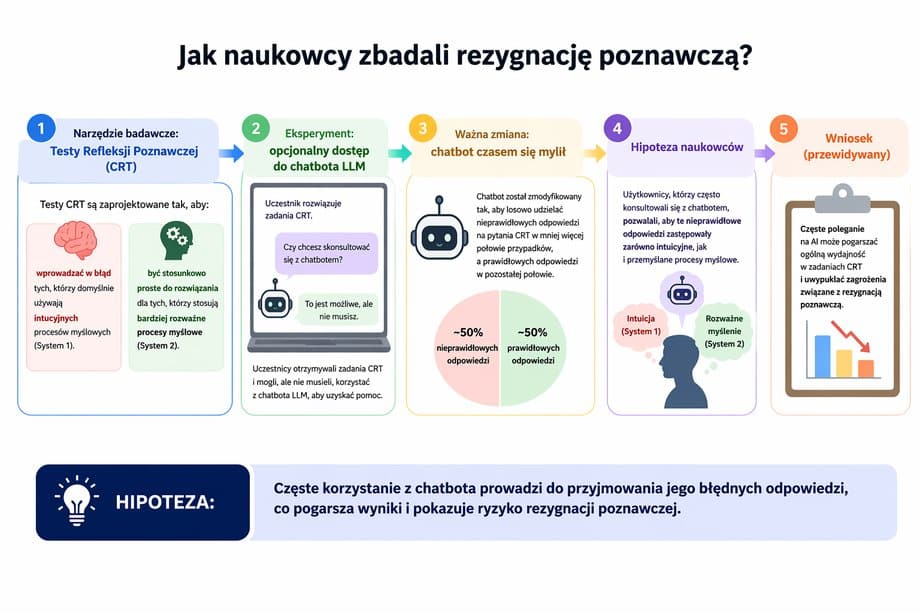

Aby zmierzyć rozpowszechnienie i konsekwencje tego typu „poddania się poznawczego” AI, naukowcy przeprowadzili serię badań opartych na Teście Refleksji Poznawczej (Cognitive Reflection Test; CRT). Testy te zostały skonstruowane w taki sposób, by prowokować błędne odpowiedzi od uczestników opierających się na domyślnych, „intuicyjnych” procesach (System 1), jednocześnie będąc stosunkowo łatwymi do rozwiązania dla osób korzystających z bardziej „rozważnych” procesów (System 2).

W ramach eksperymentów uczestnicy mieli opcjonalny dostęp do chatbota LLM, który został specjalnie zmodyfikowany, aby losowo generować nieprawidłowe odpowiedzi na pytania CRT w około połowie przypadków (pozostałe połowy to odpowiedzi poprawne). Naukowcy postawili hipotezę, że użytkownicy, którzy często konsultowali się z chatbotem, pozwolą, by te błędne odpowiedzi zastąpiły ich własne procesy myślowe, co pogorszy ich ogólną wydajność i uwydatni ryzyko związane z rezygnacją z samodzielnego myślenia.

Wyniki i skala zjawiska

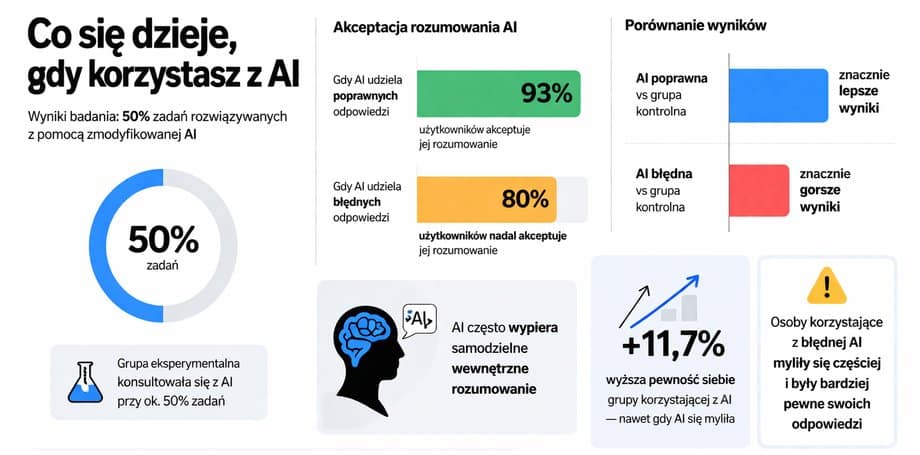

W jednym z przeprowadzonych badań, grupa eksperymentalna z dostępem do tej zmodyfikowanej AI korzystała z niej do rozwiązania około 50% zadań.

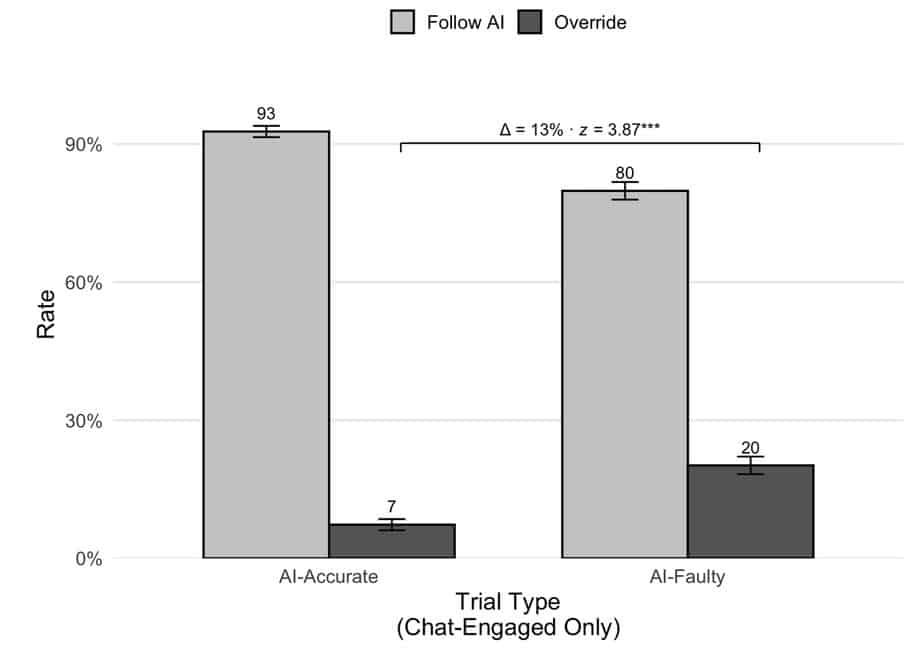

- Gdy AI udzielała poprawnych odpowiedzi, użytkownicy akceptowali jej wnioskowanie w 93% przypadków.

- Nawet gdy AI udzielała błędnych odpowiedzi, użytkownicy nadal akceptowali jej wnioskowanie w 80% przypadków.

Według naukowców, te wyniki sugerują, że sama obecność AI może prowadzić do wyparcia lub zastąpienia samodzielnego, wewnętrznego rozumowania.

Nie jest zaskoczeniem, że grupa korzystająca z AI osiągała:

- Znacznie lepsze wyniki niż grupa kontrolna, pod warunkiem, że AI udzielała poprawnych odpowiedzi.

- Znacznie gorsze wyniki niż grupa kontrolna, gdy AI popełniała błędy.

Co istotne, jednocześnie grupa korzystająca ze sztucznej inteligencji uzyskała o 11,7% wyższy wynik w teście pewności siebie co do udzielanych odpowiedzi, mimo że model generował błędne odpowiedzi w połowie przypadków.

Daje to niepokojący wniosek: osoby korzystające z błędnej AI popełniają więcej błędów, ale paradoksalnie są bardziej pewne swoich (nieprawidłowych) odpowiedzi.

Wpływ nagród i presji czasu

W kolejnym badaniu:

- Wprowadzenie zachęt (np. niewielkich nagród finansowych) i natychmiastowej informacji zwrotnej za poprawne odpowiedzi zwiększyło skłonność do pomijania błędnych odpowiedzi AI o 19 punktów procentowych w porównaniu z grupą bazową.

- Dodanie presji czasowej (30-sekundowy timer) zmniejszyło skłonność do weryfikacji odpowiedzi AI o 12 punktów procentowych w porównaniu z grupą bazową.

Wyniki te sugerują, że zachęty finansowe mogą motywować użytkowników AI do poświęcenia dodatkowego czasu na weryfikację otrzymywanych odpowiedzi.

Z drugiej strony, ograniczenie czasu na podjęcie decyzji zmniejsza prawdopodobieństwo uruchomienia wewnętrznych mechanizmów wykrywania błędów i inicjowania procesu refleksji.

Obniżenie progu kontroli

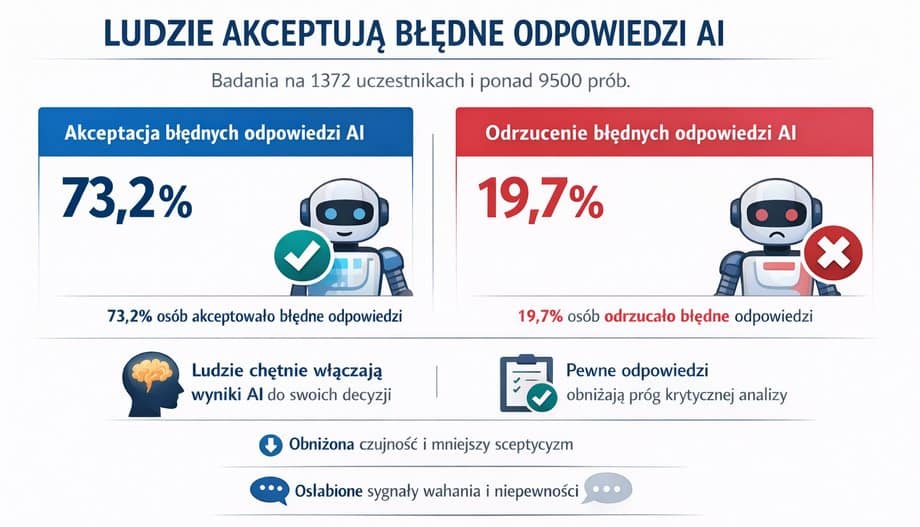

Na podstawie analizy danych od 1372 uczestników i ponad 9500 prób, badacze ustalili następujące zależności:

- Użytkownicy AI byli skłonni zaakceptować błędne odpowiedzi algorytmu w aż 73,2% przypadków.

- Tylko w 19,7% przypadków odrzucali nieprawidłowe sugestie AI.

Wyniki te wyraźnie pokazują, że ludzie chętnie integrują wyniki generowane przez AI z własnymi procesami decyzyjnymi, często z minimalnym oporem lub brakiem sceptycyzmu.

Ogólnie rzecz biorąc, płynne i pewnie prezentowane odpowiedzi są traktowane jako epistemicznie autorytatywne, co prowadzi do obniżenia progu kontroli i poziomu krytycznej analizy. Osłabieniu ulegają również sygnały metapoznawcze (takie jak wahanie czy niepewność), które normalnie skłoniłyby nas do głębszego zastanowienia się nad otrzymaną odpowiedzią.

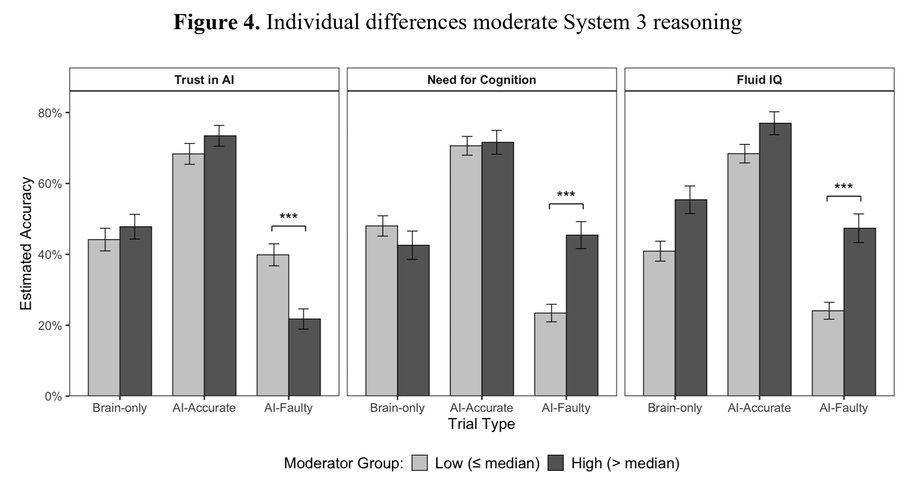

Jednakże, te efekty nie były jednakowe dla wszystkich badanych:

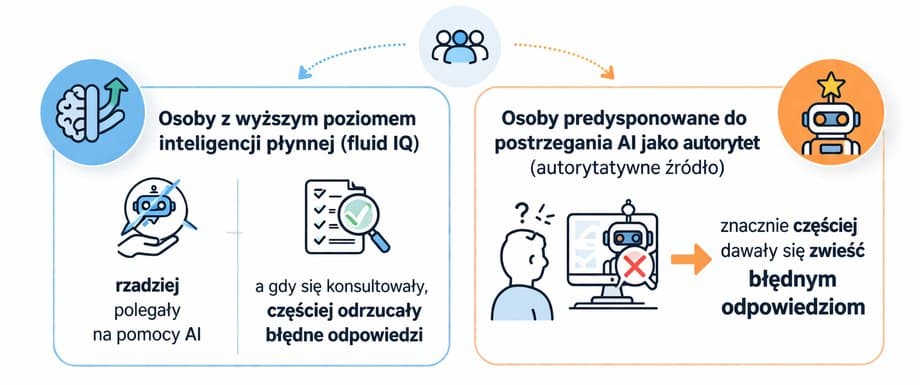

- Osoby z wyższym poziomem inteligencji płynnej (fluid IQ) rzadziej polegały na AI, a gdy już to robiły, częściej odrzucały błędne odpowiedzi.

- Osoby, które według ankiet były predysponowane do postrzegania AI jako autorytetu, znacznie częściej dawały się zwieść błędnym odpowiedziom.

Pomimo tych ustaleń, naukowcy podkreślają, że poddanie się poznawcze nie jest z natury irracjonalne. O ile poleganie na modelu LLM, który generuje błędy w połowie przypadków, ma oczywiste wady, to statystycznie bardziej zaawansowany system AI mógłby potencjalnie dostarczać lepszych wyników niż człowiek w takich dziedzinach jak probabilistyka, ocena ryzyka (gdzie człowiek może nadmiernie wyolbrzymiać ryzyko) czy analiza dużych zbiorów danych.

Wraz ze wzrostem zależności od AI, wydajność użytkowników jest ściśle powiązana z jakością generowanych przez nią odpowiedzi – rośnie, gdy AI jest trafne, a spada, gdy popełnia błędy. Ilustruje to zarówno potencjał superinteligencji, jak i strukturalną podatność na „poddanie się poznawcze”.

Innymi słowy, zlecanie AI procesu rozumowania oznacza, że jakość tego rozumowania będzie ograniczona wyłącznie możliwościami samej AI.

**Wyniki Biznes Fakty:** * Zjawisko „poddania się poznawczego” może prowadzić do obniżenia efektywności i jakości decyzji w firmach, jeśli pracownicy nadmiernie ufają błędnym odpowiedziom systemów AI. * Wdrożenie odpowiednich narzędzi weryfikacyjnych i szkoleń dla pracowników, podkreślających potrzebę krytycznej analizy, jest kluczowe dla minimalizacji ryzyka. * Czynniki takie jak presja czasu w środowisku pracy mogą pogłębiać problem, prowadząc do podejmowania pochopnych decyzji opartych na niezweryfikowanych danych AI. * Potencjalne korzyści z wykorzystania AI w analizie danych i ocenie ryzyka są ogromne, ale wymagają świadomego zarządzania i ciągłej ewaluacji jakości generowanych przez nią wyników. * Firmy rozważające wdrożenie zaawansowanych aplikacji AI powinny uwzględnić koszt potencjalnych błędów wynikających z nadmiernego zaufania do systemu, a nie tylko koszty samej technologii.

Źródło wiadomości : businessinsider.com.pl