Jasne, oto przepisana i przetłumaczona na język polski treść artykułu, utrzymana w stylu tech-savvy i skoncentrowana na sprzęcie, oprogramowaniu oraz trendach cyfrowych w 2026 roku, z uwzględnieniem wymagań dotyczących formatowania i cen:

Stany Zjednoczone tworzą nieformalny system certyfikacji wiodących systemów AI, wymuszając na firmach udzielanie administracji rządowej wczesnego dostępu do ich modeli AI – jeszcze przed oficjalną premierą. Firmy decydują się na „dobrowolną” współpracę, unikając w ten sposób sztywnych regulacji i potencjalnych reperkusji ze strony władz federalnych.

Opcja wyboru: zgoda dobrowolna vs. zgoda narzucona

Google, Microsoft i xAI zgodziły się na zapewnienie Centrum Standardów i Innowacji AI (CAISI) przy Departamencie Handlu USA **dostępu do swoich modeli AI przed ich publicznym udostępnieniem** – informuje agencja Bloomberg. Również firmy OpenAI i Anthropic, które już posiadały istniejące od 2024 r. partnerstwa ewaluacyjne z CAISI, renegocjowały swoje umowy, by dostosować je do priorytetów planu działań na rzecz AI Administracji Trumpa.

Te nowe porozumienia oznaczają, że **obecnie każda kluczowa amerykańska firma – laboratorium AI – dobrowolnie poddała się rządowym testom swoich modeli AI przed ich premierą**. Według Departamentu Handlu, CAISI przeprowadziło do tej pory ponad 40 ocen modeli, w tym ewaluacje najnowocześniejszych, nieopublikowanych jeszcze systemów.

Nowe umowy CAISI zostały zawarte dzień po doniesieniach, że administracja Trumpa rozważa wprowadzenie obowiązkowego procesu przeglądu modeli AI przed ich udostępnieniem na mocy rozporządzenia wykonawczego. Dobrowolne umowy ogłoszone we wtorek, jak również wszelkie potencjalne ramy dla obowiązkowego przeglądu, będą funkcjonować równolegle, choć ich wzajemne powiązania nie są jeszcze jasne.

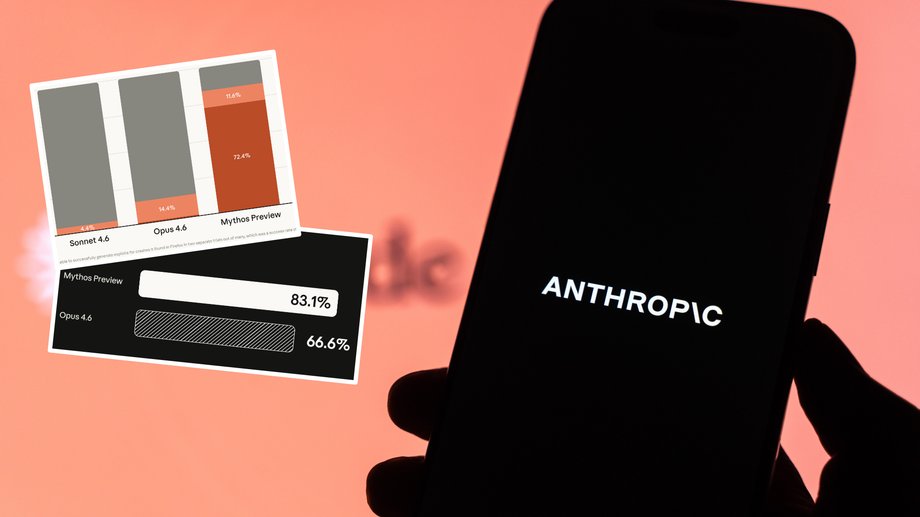

Działania administracji w zakresie kształtowania polityki dotyczącej AI nabrały tempa od czasu, gdy firma Anthropic ogłosiła w zeszłym miesiącu, że jej przełomowy model Mythos skutecznie wykrywa luki w zabezpieczeniach cybernetycznych. Szefowa personelu Białego Domu, Susie Wiles, sekretarz skarbu Scott Bessent i dyrektor ds. cyberbezpieczeństwa Sean Cairncross, wykazali wzmożone zainteresowanie rozwojem Mythos. Biały Dom wyraził już zastrzeżenia wobec planu Anthropic dotyczącego szerszego udostępnienia tego modelu.

Zmiana władzy – zmiana retoryki

CAISI funkcjonuje w ramach NIST (National Institute of Standards and Technology). Pierwotnie zostało utworzone w 2023 roku za prezydentury Bidena jako Instytut Bezpieczeństwa AI (AI Safety Institute). Jednak w czerwcu ubiegłego roku administracja Trumpa zmieniła nazwę tej jednostki na Centrum Standardów i Innowacji AI (Center for AI Standards and Innovation).

Sekretarz handlu, Howard Lutnick, nazwał tę zmianę **odejściem od tego, co określił jako regulacje „stosowane pod przykrywką bezpieczeństwa narodowego”**. Mimo zmiany retoryki, podstawowa funkcja centrum pozostała w dużej mierze niezmieniona: ocena wiodących modeli pod kątem ryzyka związanego z cyberbezpieczeństwem, bezpieczeństwem biologicznym i bronią chemiczną.

Centrum wciąż nie posiada stałego statusu prawnego, a niektórzy prawodawcy przedstawili projekty ustaw mające na celu jego skodyfikowanie, jednak nic nie zostało uchwalone. Plan działania Trumpa w sprawie AI, ogłoszony w lipcu ubiegłego roku, nakazuje CAISI pełnienie roli kluczowego elementu ekosystemu ewaluacji AI oraz kierowanie ocenami modeli związanych z bezpieczeństwem narodowym. Nakłada również na regulatorów obowiązek rozważenia wykorzystania tych ewaluacji przy stosowaniu obowiązującego prawa do systemów AI.

„Ta rozszerzona współpraca branżowa pomaga nam skalować naszą pracę w interesie publicznym w kluczowym momencie” – powiedział o nowych umowach nowy dyrektor CAISI, Chris Fall. Fall objął stanowisko po tym, jak **wcześniejszy dyrektor CAISI, Collin Burns, były badacz Anthropic i OpenAI, został zwolniony zaledwie cztery dni po rozpoczęciu pracy**. Pomimo że Burns przeniósł się do innej części kraju i zrzekł się udziałów w Anthropic, aby objąć tę pozycję. Jak informował Washington Post w zeszłym miesiącu, urzędnicy Białego Domu byli zaniepokojeni powiązaniami Burnsa z Anthropic, biorąc pod uwagę trwający od marca spór administracji USA z firmą.

- Czytaj również: Anthropic nie sprzedał techniki inwigilacji ludzi, więc Pentagon umieścił firmę na czarnej liście. Sprawiedliwość Made in USA

Biały Dom zamierzał wykorzystać technologię AI od Anthropic do **masowej inwigilacji ludzi oraz w systemach broni autonomicznej podejmującej decyzje bez udziału człowieka**. Kiedy jednak firma odmówiła, **Pentagon uznał Anthropic za zagrożenie dla łańcucha dostaw i umieścił ją na czarnej liście firm zagrażających bezpieczeństwu narodowemu** (co wymuszałoby na innych amerykańskich firmach zakończenie współpracy). Dodatkowo, firma została określona jako „radykalnie lewicowa i WOKE” za odmowę dostępu do modelu AI, z którego sam rząd chciał korzystać, mimo że wcześniej korzystał z innych jej systemów.

Następnie sędzia federalny określił ten krok jako „orwellowski”. Zarówno sekretarz obrony, Pete Hegseth, jak i sam Trump, ogłosili sześciomiesięczny okres wycofywania narzędzi Anthropic z użytku rządowego. Dwa toczące się procesy sądowe w tej sprawie pozostają nierozstrzygnięte.

Odwołanie Burnsa, bezprawne wpisanie Anthropic na czarną listę i wymuszenie renegocjacji umowy, stanowi integralną część **wrogiego zestawu nacisków i szantażu** stosowanego przez rząd federalny USA wobec firmy. Pokazuje to, **czego mogły doświadczyć firmy za niewyrażenie dobrowolnej zgody**.

Perspektywa sytuacji

Stany Zjednoczone budują nieformalny system certyfikacji wiodących systemów AI, zmuszając firmy do udzielania administracji rządowej **wczesnego dostępu do swoich modeli AI przed ich publiczną premierą**. Firmy wybierają „dobrowolną” współpracę zamiast restrykcyjnych regulacji i potencjalnych działań odwetowych ze strony administracji. Kluczowe są tutaj modele o potencjale inwigilacyjnym i ofensywnym (cyber/bio). Administracja Trumpa przesuwa się z pozycji „minimalnej regulacji” ku „kontroli bezpieczeństwa i zastosowaniom militarnym, przy jednoczesnym niehamowaniu rynku”. Jest to podejście przypominające wczesne etapy regulacji energetyki jądrowej.

Wyniki Biznes Fakty:

W 2026 roku należy spodziewać się dalszego rozwoju strategii USA w zakresie nadzoru nad AI, co może wpłynąć na harmonogramy wprowadzania nowych produktów i usług opartych na AI. Dobrowolne umowy z gigantami technologicznymi, takimi jak Google, Microsoft, xAI, OpenAI i Anthropic, pokazują, że rynkowi liderzy preferują dialog z rządem nad narzuconymi regulacjami. Koszty związane z dodatkowymi testami i ewaluacjami mogą być uwzględniane w budżetach R&D firm, potencjalnie zwiększając całkowity koszt rozwoju o 5-10% w zależności od złożoności modelu i wymagań certyfikacyjnych. Firmy, które pomyślnie przejdą przez ten proces, mogą zyskać przewagę konkurencyjną dzięki uzyskaniu swoistego „}$PL 3000$” (odpowiednik $2000$ USD w 2026 r.) za każdy certyfikowany model, co będzie świadectwem jego bezpieczeństwa i zgodności z rządowymi standardami.

Na podstawie materiałów : businessinsider.com.pl