Microsoft po raz kolejny zalicza wpadkę z wykorzystaniem sztucznej inteligencji. Tym razem ich narzędzie „przerobiło” istniejący diagram, publikując go na oficjalnej stronie firmy. Nietypowe słowo, które pojawiło się w wyniku tej operacji, błyskawicznie stało się internetowym memem.

Wygląda na to, że Microsoft robi wszystko, by udowodnić, że sztuczna inteligencja potrafi być bardziej „sztuczna” niż „inteligentna”. Najnowsza historia, która zelektryzowała branżę IT, jest doskonałym przykładem tego, jak nie należy korzystać z AI – szczególnie, gdy jest się firmą, która agresywnie promuje tę technologię.

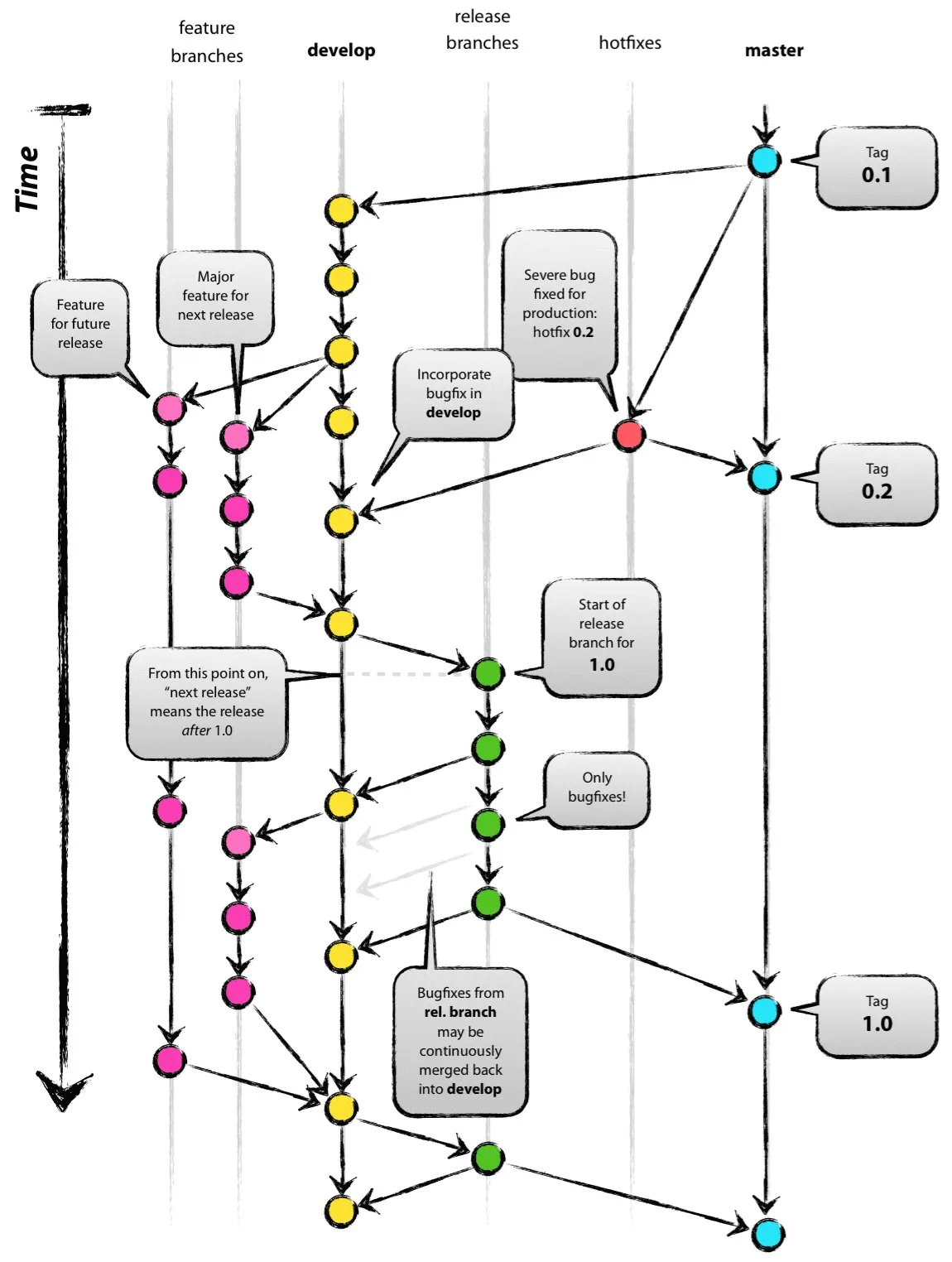

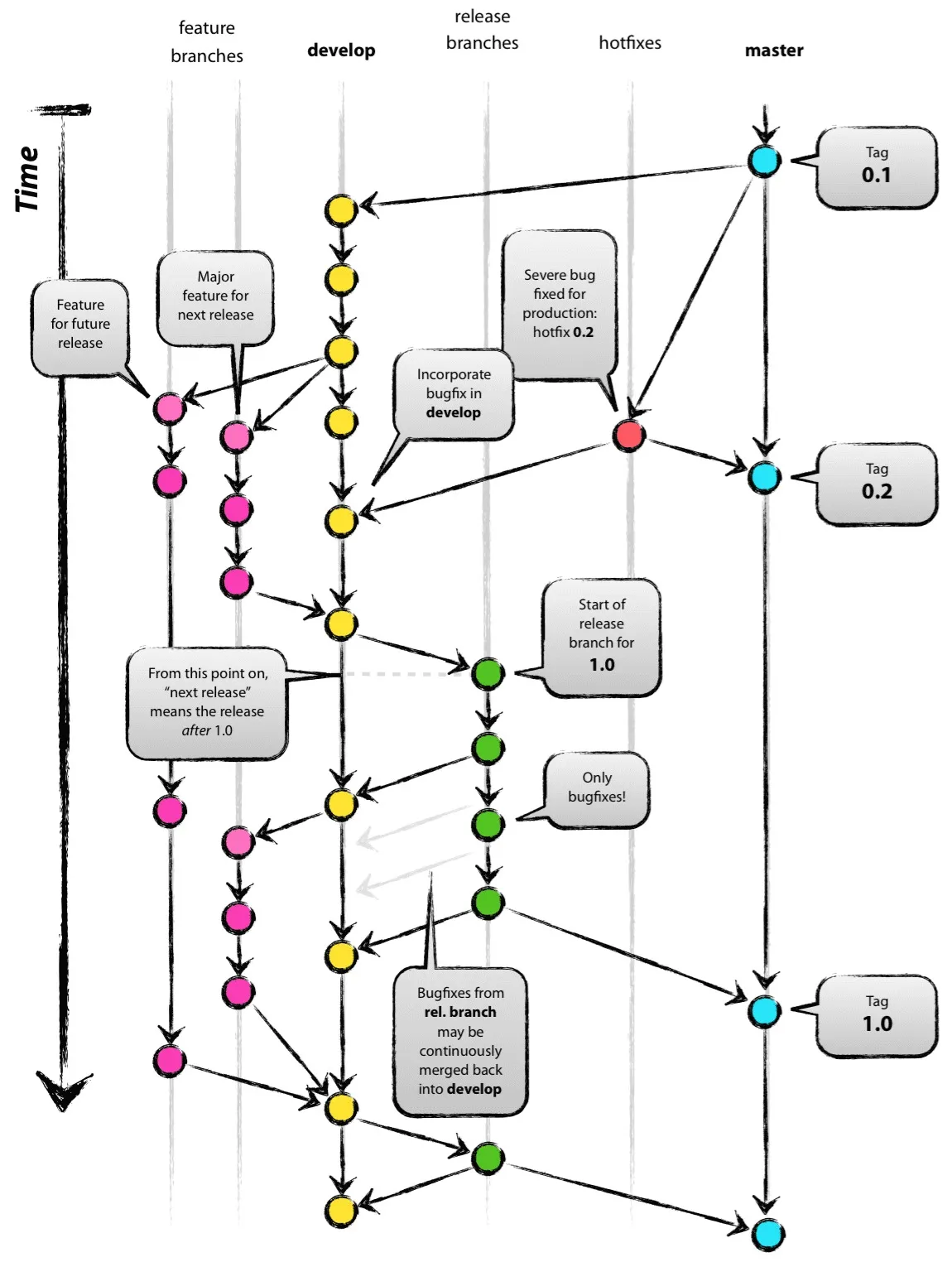

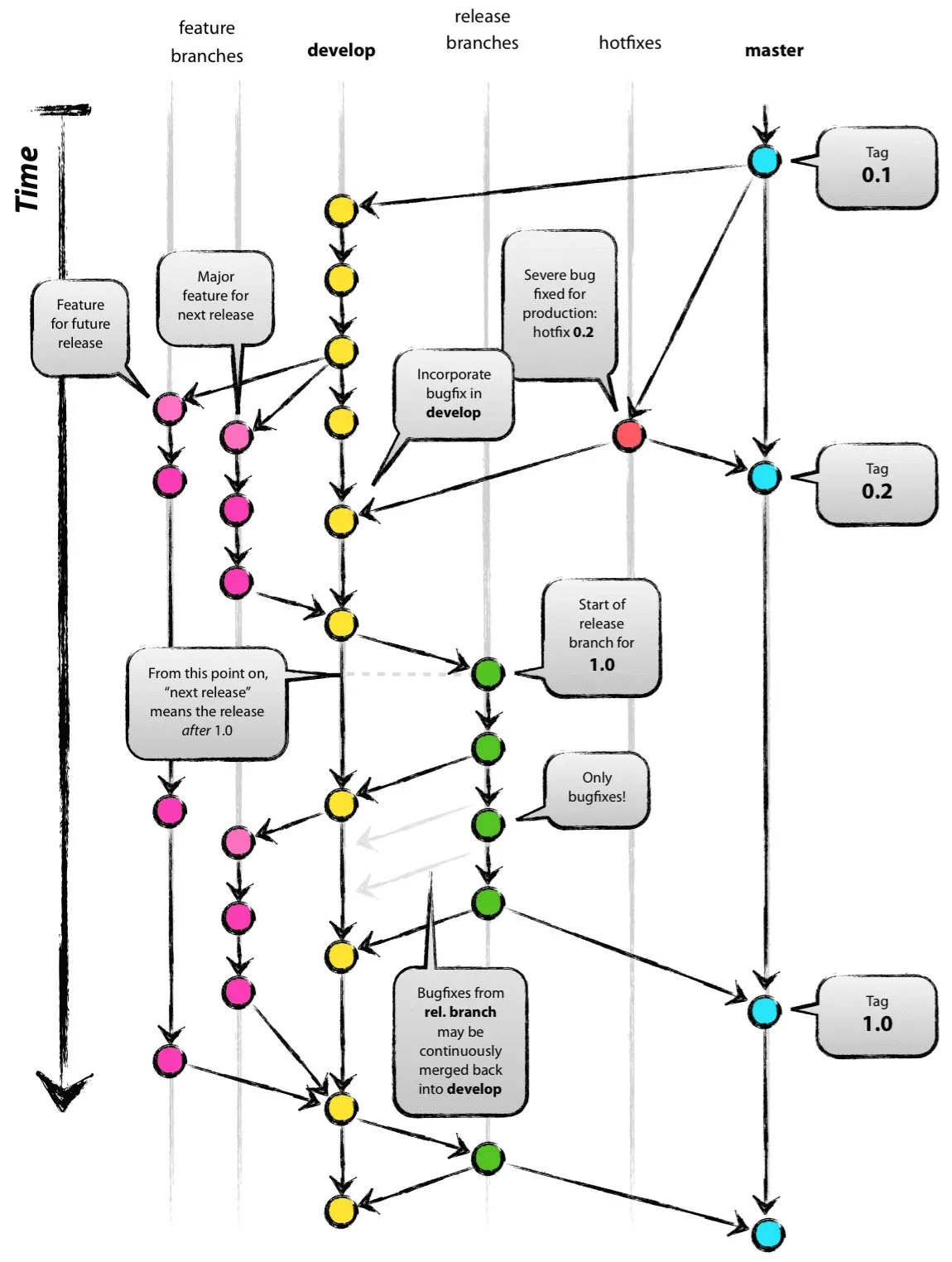

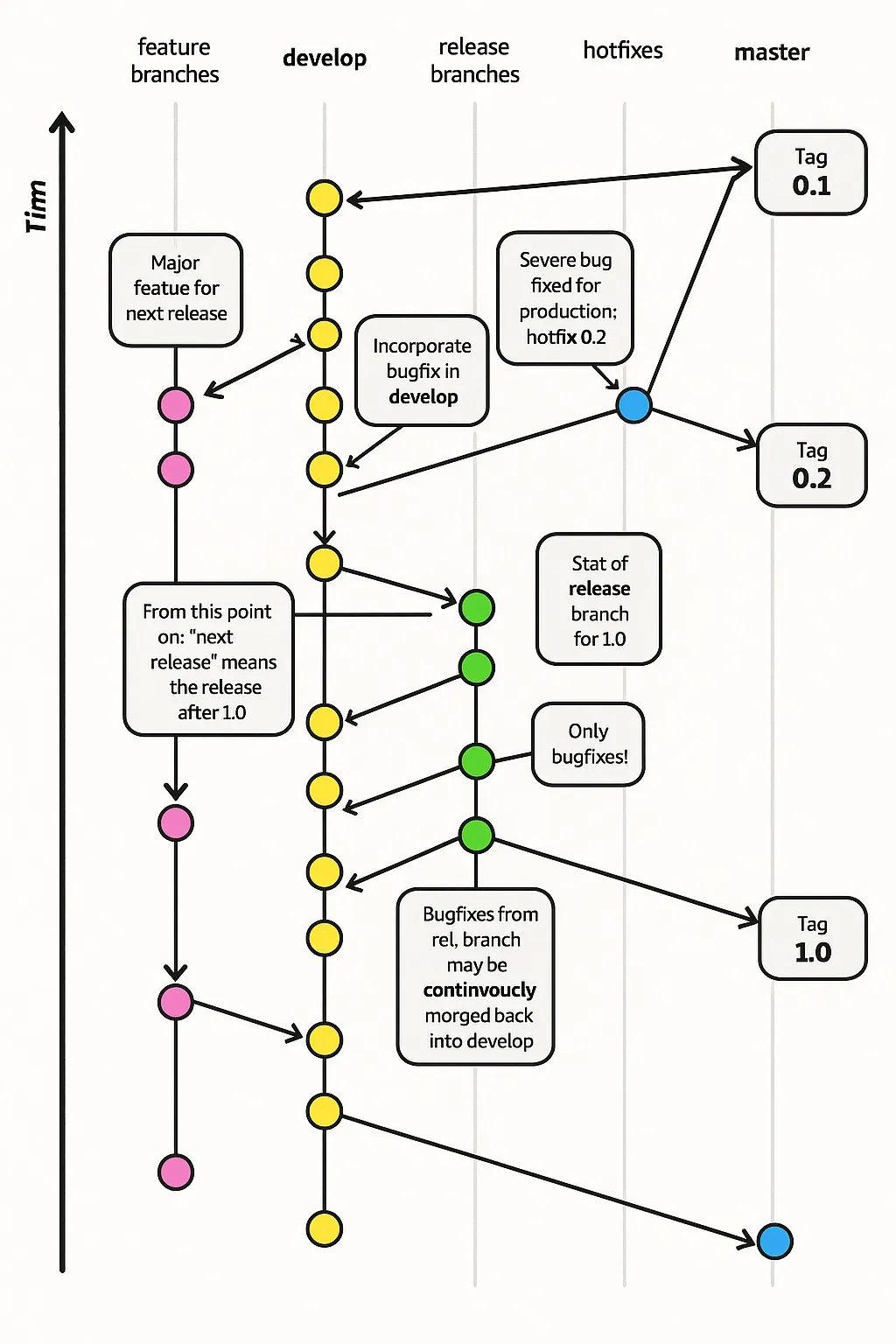

Cała sprawa rozpoczęła się od grafiki, która pojawiła się na oficjalnym portalu Microsoft Learn. Diagram miał służyć jako wizualne wyjaśnienie modelu pracy z gałęziami w systemie kontroli wersji Git. Problem polegał na tym, że ten diagram już istniał – i to od 2010 roku. Jego autorem jest Vincent Driessen, twórca znanej publikacji „A successful Git branching model”, która przez lata stała się fundamentalnym odniesieniem dla tysięcy programistów na całym świecie.

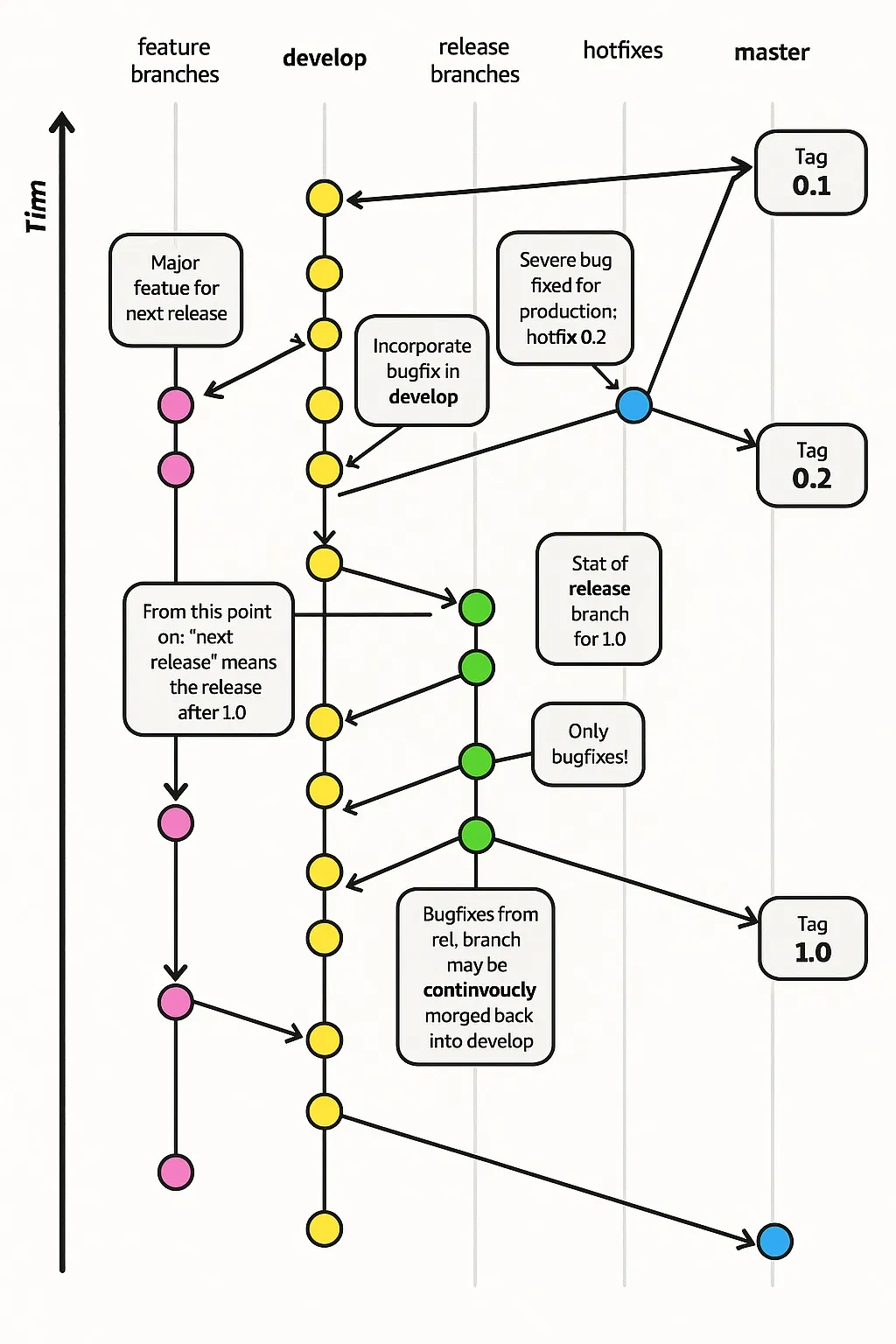

Microsoft nie tylko wykorzystał jego pracę bez podania źródła, ale co gorsza, postanowił przepuścić ją przez generator obrazów. Narzędzie AI, jak to często bywa, odtworzyło diagram w sposób, który można określić jako chaotyczny i niechlujny („slop”). Kolory uległy zmianie, proporcje zostały zaburzone, strzałki prowadziły donikąd, a podpisy wyglądały, jakby były wynikiem nieudanego tłumaczenia z użyciem autokorekty. „Microsoft continvoucly morged my diagram there for sure” – zażartował sam Driessen, komentując jedną z tych absurdalnych „halucynacji” AI.

Literówkowa „perełka” stała się symbolem całego zdarzenia

Sztuczna inteligencja próbowała odtworzyć oryginalne podpisy, jednak zakończyło się to nonsensownym bełkotem, który nie miał znaczenia ani w języku angielskim, ani w kontekście systemu Git. Driessen przyznał, że przez lata jego diagram był wielokrotnie kopiowany w prezentacjach, publikacjach czy firmowych bazach wiedzy – i nigdy nie stanowiło to dla niego problemu. Tym razem jednak nie chodziło o zwykłe kopiowanie. Chodziło o celowe „przetworzenie” jego pracy przez generator AI, jej zniekształcenie i opublikowanie jako oficjalnego materiału edukacyjnego firmy Microsoft.

To już nie jest inspiracja. To jest ewidentny brak szacunku dla autora oryginalnego dzieła oraz dla odbiorców materiału.

Galeria: 2 zdjęciaGaleria zdjęć

1/2 Oryginalny diagram

Ta historia jest istotna, ponieważ ilustruje szerszy trend. Sztuczna inteligencja jest coraz częściej wykorzystywana jako narzędzie do „odświeżania” istniejących treści, aby prezentowały się jako nowe i oryginalne, minimalizując jednocześnie zaangażowanie człowieka. Teoretycznie ma to przyspieszyć procesy tworzenia materiałów. W praktyce często prowadzi do powstawania błędów, tzw. „halucynacji” AI oraz naruszeń praw autorskich.

Driessen zauważył, że jego diagram jest na tyle charakterystyczny, że łatwo było zidentyfikować, co się stało. Ale co z mniej rozpoznawalnymi materiałami? Co z grafikami, które AI „przerobi” w taki sposób, że nikt nie zauważy, iż doszło do kradzieży intelektualnej?

Na obecną chwilę nie jest jasne, w jaki sposób dokładnie doszło do publikacji tego „dzieła”. Czy ktoś użył narzędzia Copilot? Czy grafika została wygenerowana automatycznie? Czy ktokolwiek sprawdził jej poprawność przed udostępnieniem na oficjalnej stronie? Scott Hanselman z Microsoftu podjął próbę eleganckiego wyjaśnienia sytuacji i załagodzenia kontrowersji, jednakże niesmak po tym zdarzeniu z pewnością pozostanie.

Vincent Driessen nie domaga się odszkodowania ani nie dąży do wywołania wielkiej afery. Jego jedyne oczekiwania to oficjalne wyjaśnienie sytuacji przez Microsoft, dodanie odnośnika do oryginalnego źródła oraz zapewnienie, że podobne wpadki nie będą miały miejsca w przyszłości. To naprawdę niewielkie żądania wobec firmy, która dysponuje zasobami pozwalającymi na zatrudnienie specjalistów potrafiących odróżnić prawidłowe „merge” od błędnego „morged”.

Wyniki Biznes Fakty:

Incydent z grafiką Git na platformie Microsoft Learn podkreśla wyzwania związane z odpowiedzialnym wdrażaniem narzędzi AI w środowisku korporacyjnym. Pokazuje, że nawet zaawansowane technologie wymagają ludzkiej weryfikacji i etycznego podejścia do praw autorskich. Choć cena za potencjalne błędy AI może wydawać się niewielka, długoterminowe skutki dla reputacji marki i zaufania klientów mogą być znaczące. W kontekście cyfrowych trendów na rok 2026, gdzie AI ma odgrywać kluczową rolę w transformacji biznesowej, tego typu wpadki stanowią ostrzeżenie dla firm inwestujących w te technologie. Właściwe zarządzanie treściami generowanymi przez AI, w tym dokładne sprawdzanie ich poprawności merytorycznej i prawnej, powinno stać się standardową praktyką.

Na podstawie materiałów : spidersweb.pl