Giganci technologiczni generują miliony dolarów, oferując narzędzia AI do tworzenia nielegalnych deepfake’ów w wersji nude. Co gorsza, ich własne algorytmy wyszukiwania i systemy reklamowe kierują nawet najmłodszych użytkowników do tych szkodliwych aplikacji.

Nowy raport **Tech Transparency Project (TTP)**, opublikowany w kwietniu 2026 roku, odsłania zatrważający obraz, który powinien budzić niepokój każdego rodzica i użytkownika smartfona. Pomimo istnienia jasnych polityk Apple i Google, zabraniających publikowania aplikacji typu „nudify” – narzędzi AI zdolnych w mgnieniu oka usunąć ubrania ze zdjęć — ich firmowe sklepy nie tylko udostępniają tego typu oprogramowanie, ale wręcz aktywnie kierują do niego użytkowników.

- Przeczytaj również: Rozebrane przez technologię [FELIETON]

Aplikacje te potrafią generować nagie zdjęcia osób bez ich zgody, implementować twarze w materiały pornograficzne lub tworzyć chatboty o charakterze seksualnym. Co najbardziej niepokojące, wiele z nich posiada niskie oceny wiekowe, co oznacza, że mogą je swobodnie pobierać dzieci i młodzież.

Jak Apple i Google sami kierują użytkowników do niebezpiecznych aplikacji?

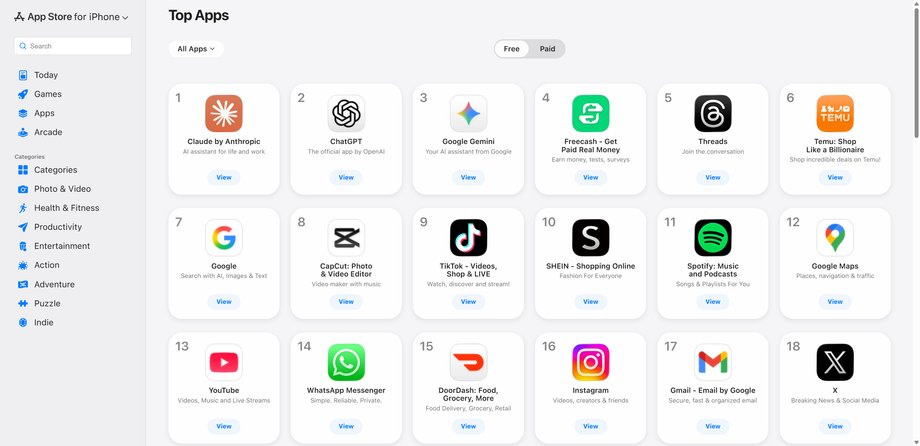

Analitycy TTP stworzyli nowe profile w App Store i Google Play, a następnie wprowadzili popularne zapytania, takie jak „nudify”, „undress”, „deepnude”, „deepfake”, „adult AI”, „face swap” czy „AI NSFW”. Uzyskane wyniki są szokujące i dowodzą, że nie jest to problem marginalny, lecz systemowy mechanizm zwiększający widoczność niebezpiecznych narzędzi.

W App Store wyszukiwania wygenerowały 46 unikalnych aplikacji, z czego aż 18 (39,1%) posiadało funkcjonalność cyfrowego usuwania ubrań ze zdjęć kobiet lub generowania treści o charakterze seksualnym. W Google Play, spośród 49 aplikacji, 20 (40,8%) oferowało podobne możliwości.

- Przeczytaj również: Polska szykuje zakaz social mediów dla dzieci. Możliwe kary dla big techów

Co jeszcze bardziej zatrważające, systemy obu firm aktywnie podsuwają kolejne potencjalnie niebezpieczne sugestie. Funkcja autouzupełniania, podczas wpisywania hasła, proponuje frazy prowadzące wprost do tego typu aplikacji. Reklamy tych aplikacji pojawiają się również na szczycie wyników wyszukiwania. W App Store są one wyraźnie oznaczone jako płatne reklamy i wyświetlają się jako pierwsze. W Google Play sponsorowane aplikacje pojawiają się powyżej, obok lub poniżej wyników organicznych, w tym w formie karuzeli „sugerowane dla Ciebie”, wypełnionej treściami o charakterze erotycznym.

Nie jest to przypadek ani błąd algorytmu. To celowa promocja oparta na mechanizmach reklamowych i rekomendacyjnych, które obie firmy w pełni kontrolują. Apple czerpie z tego zyski dzięki systemowi licytacji reklam, a Google poprzez płatne lokowanie produktów. Jednocześnie obie platformy oficjalnie zakazują treści seksualnych i materiałów przeznaczonych dla dorosłych w swoich kampaniach reklamowych, co czyni tę sytuację szczególnie cyniczną.

Aplikacje dostępne dla dzieci. 31 z nich ma niskie ratingi wiekowe

Najbardziej alarmujący aspekt raportu dotyczy dostępności tych aplikacji dla osób nieletnich. Badacze zidentyfikowali aż **31 aplikacji** sklasyfikowanych jako odpowiednie dla dzieci lub nastolatków. Przykłady są zatrważające. W Google Play aplikacja **FaceTool: Face Swap & Generate** ma rating „dla wszystkich” i pozwala na umieszczanie twarzy na nagich ciałach – wystarczy przesłać zdjęcie znajomej osoby, aby po chwili uzyskać jej wersję topless. To jednak tylko jeden z wielu przykładów.

Sytuacja w App Store nie wygląda lepiej. Aplikacje takie jak **Best Body AI — Fashion Editor**, po wyszukaniu frazy „nudify”, umożliwiają usunięcie ubrań ze zdjęcia, prezentując nagość od pasa w górę. Natomiast **AI Replace & Remove — Fill App**, po wpisaniu „undress”, identyfikuje ubrania i je usuwa, pokazując rozmytą miniaturkę nagości. Pełny efekt wymaga jednak wykupienia subskrypcji!

- Przeczytaj również: „Filtry podsycały kompleksy”. Matki winią media społecznościowe za śmierć dzieci

Te narzędzia nie ograniczają się jedynie do manipulacji statycznymi zdjęciami. Wiele z nich potrafi generować filmy pornograficzne z wykorzystaniem deepfake’ów lub tworzyć materiały wideo, w których postacie wirtualnie zdejmują ubrania. Część aplikacji pochodzi od deweloperów z Chin, Wietnamu i Indonezji, co dodatkowo komplikuje kwestie bezpieczeństwa danych osobowych.

480 mln pobrań i 122 mln USD. Biznesplan oparty na krzywdzie

Skala tego procederu jest przytłaczająca. Według danych firmy analitycznej AppMagic, zidentyfikowane aplikacje umożliwiające „rozbieranie” zdjęć zostały pobrane łącznie ponad **480 milionów razy**, generując ponad **122 miliony dolarów** przychodu przez cały okres ich istnienia. Apple i Google pobierają z tego tytułu procent od zakupów w aplikacjach oraz zyski z reklam. Oznacza to, że giganci technologiczni zarabiają bezpośrednio na narzędziach, które mogą być wykorzystywane do nękania i wykorzystywania seksualnego.

To jednak nie koniec tej historii. Raport TTP jest jedynie konsekwencją styczniowego śledztwa, które ujawniło ponad sto podobnych aplikacji. Po tamtej publikacji Google i Apple usunęły dziesiątki z nich, jednak najwyraźniej nie zmieniły mechanizmów wyszukiwania i reklam, co doprowadziło do powrotu problemu w jeszcze bardziej widocznej formie.

Reakcja gigantów? Apple milczy, Google „prowadzi śledztwo”

Po przekazaniu ustaleń TTP i serwisowi Bloomberg News, Apple usunęło 15 aplikacji wymienionych w raporcie. Firma jednak odmawia jakichkolwiek komentarzy dotyczących tego, dlaczego jej system reklamowy i wyszukiwarka tak skutecznie promują zakazane treści.

- Przeczytaj również: Czy można pozwać za uzależnienie dziecka? To wojna, nie proces — ostrzega prawnik

Google usunęło siedem aplikacji i wydało lakoniczne oświadczenie: „Gdy zgłaszane są naruszenia naszych wytycznych, badamy sprawę i podejmujemy odpowiednie działania”. Google dodało również, że oceny wiekowe aplikacji ustala zewnętrzna organizacja International Age Rating Coalition, a nie sama platforma. Żadna z firm nie wyjaśniła, dlaczego funkcje autouzupełniania i reklamy nadal kierują użytkowników do tych szkodliwych aplikacji.

Dziękujemy za przeczytanie artykułu do końca. Bądź na bieżąco! Obserwuj nas w Google.

### Wyniki Biznes Fakty: * **Przychody z „nudify” apps:** Ponad 122 miliony dolarów (ok. 488 mln PLN przy kursie 4 PLN/USD z 2026 r.) wygenerowane przez aplikacje umożliwiające usuwanie ubrań ze zdjęć. * **Liczba pobrań:** Ponad 480 milionów pobrań zidentyfikowanych aplikacji. * **Prowizje dla gigantów:** Apple i Google czerpią bezpośrednie zyski z prowizji od zakupów w aplikacjach oraz z wyświetlania reklam. * **Brak transparentności:** Firmy odmawiają komentarza na temat mechanizmów promowania szkodliwego oprogramowania, pomimo usunięcia części aplikacji po publikacji raportu. * **Ryzyko dla nieletnich:** Aż 31 aplikacji o niskim ratingu wiekowym jest łatwo dostępnych dla dzieci i młodzieży, co stwarza realne zagrożenie wykorzystania. * **Aktywna promocja:** Systemy wyszukiwania i autouzupełniania aktywnie kierują użytkowników do aplikacji generujących treści o charakterze seksualnym, mimo oficjalnych zakazów. * **Wartość rynku:** Szacuje się, że rynek aplikacji z funkcjami deepfake i manipulacji zdjęciami o charakterze seksualnym może osiągać setki milionów dolarów rocznie globalnie.

Informacje przygotowane na podstawie materiałów : businessinsider.com.pl